最近,輝達開源了首個在Blackwell架構上最佳化的DeepSeek-R1,實現了推理速度提升25倍,和每token成本降低20倍的驚人成果。同時,DeepSeek連續開源多個輝達GPU最佳化項目,共同探索模型性能極限。

當FP4的魔法與Blackwell的強大算力相遇,會碰撞出怎樣的火花?

答案是:推理性能暴漲25倍,成本狂降20倍!

隨著DeepSeek-R1本地化部署的爆火,輝達也親自下場,開源了首個基於Blackwell架構的最佳化方案——DeepSeek-R1-FP4。

在新模型的加持下,B200實現了高達21,088 token每秒的的推理吞吐量,相比於H100的844 token每秒,提升了25倍。

與此同時,每token的成本也實現了20倍的降低。

通過在Blackwell架構上應用TensorRT DeepSeek最佳化,輝達讓具有FP4生產級精度的模型,在MMLU通用智能基準測試中達到了FP8模型性能的99.8%。

DeepSeek-R1首次基於Blackwell GPU最佳化

目前,輝達基於FP4最佳化的DeepSeek-R1檢查點現已在Hugging Face上開源。

後訓練量化

模型將Transformer模組內的線性算子的權重和啟動量化到了FP4,適用於TensorRT-LLM推理。

這種最佳化將每個參數從8位減少到4位,從而讓磁碟空間和GPU視訊記憶體的需求減少了約1.6倍。

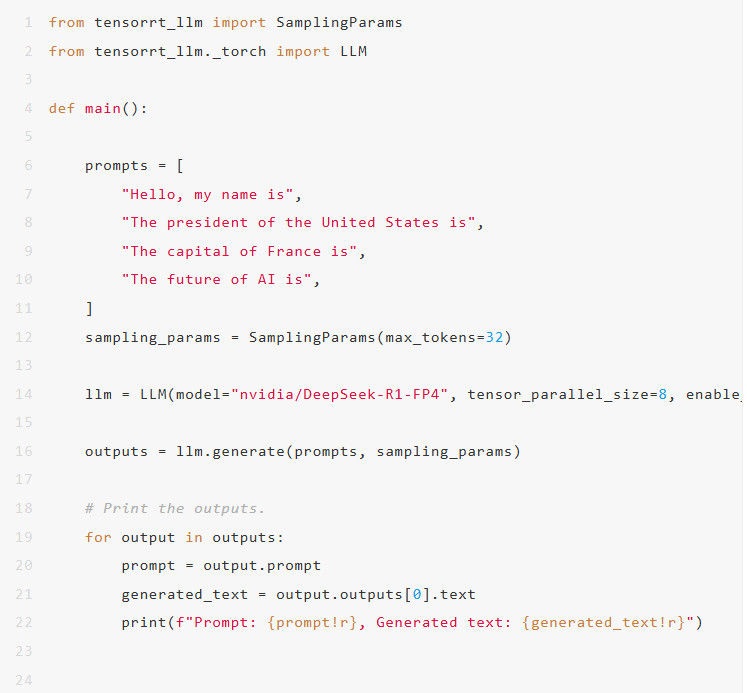

使用TensorRT-LLM部署

要使用TensorRT-LLM LLM API部署量化後的FP4權重檔案,並為給定的提示生成文字響應,請參照以下示例程式碼:

硬體要求:需要支援TensorRT-LLM的輝達GPU(如B200),並且需要8個GPU來實現tensor_parallel_size=8的張量平行。

性能最佳化:程式碼利用FP4量化、TensorRT引擎和平行計算,旨在實現高效、低成本的推理,適合生產環境或高吞吐量應用。

對於此次最佳化的成果,網友表示驚嘆。

「FP4魔法讓AI未來依然敏銳!」網友Isha評論道。

網友algorusty則聲稱,有了這次的最佳化後,美國供應商能夠以每百萬token 0.25美元的價格提供R1。

「還會有利潤。」

網友Phil則將這次的最佳化與DeepSeek本周的開源5連發結合了起來。

「這展示了硬體和開源模型結合的可能性。」他表示。

DeepSeek全面開源

如今DeepSeek持續5天的「開源周」已經進行到了第3天。

周一,他們開源了FlashMLA。這是DeepSeek專為輝達Hopper GPU打造的高效MLA解碼核心,特別針對變長序列進行了最佳化,目前已正式投產使用。

周二開源了DeepEP,這是一個專為混合專家系統(MoE)和專家平行(EP)設計的通訊庫。

周三開放原始碼的是DeepGEMM。這是一個支援稠密和MoE模型的FP8 GEMM(通用矩陣乘法)計算庫,可為V3/R1的訓練和推理提供強大支援。

總的來說,不管是輝達開放原始碼的DeepSeek-R1-FP4,還是DeepSeek開放原始碼的三個倉庫,都是通過對輝達GPU和叢集的最佳化,來推動AI模型的高效計算和部署。

參考資料:

https://x.com/NVIDIAAIDev/status/1894172956726890623 (新智元)