“ Inception Labs 推出的 Mercury 系列擴散大型語言模型,說不定會徹底改變我們對語言模型的認知。”

傳統語言模型的侷限

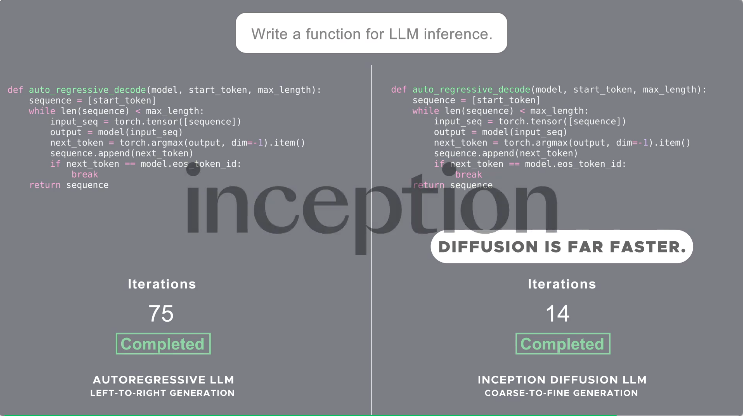

咱們現在用的很多語言模型,比如那些能寫文章、回答問題的 AI,大多是自回歸模型。這到底是個啥意思呢?簡單來說,就是它們生成文字的時候,得一個詞一個詞地來,就像咱們寫文章一樣,得一個字一個字地寫。比如說,你想讓 AI 寫個故事,它得先寫第一個詞,然後再寫第二個詞,以此類推。而且每次寫一個詞的時候,它都得計算上文所有的文字,通過一個超級複雜的神經網路來實現,而這個網路裡有幾十億甚至更多個參數。這就好比你每次寫一個字,都得先思考整個字典一樣,效率可想而知。

而且,如果想讓這些模型生成一些需要深度推理的內容,比如解決一個複雜的數學問題或者寫一篇邏輯嚴密的文章,那生成速度就會慢得讓人抓狂。因為它們得一步步來,每一步都不能出錯,這就導致了推理成本和延遲的大幅增加。就好比你讓一個蝸牛去爬一座高山,雖然它能爬到山頂,但得花上好幾年時間。

Mercury 的創新之處

(一)擴散模型原理

Mercury 用的是一種叫擴散模型的技術,這可是個大殺器。擴散模型的工作方式和傳統的自回歸模型完全不同。它不是一步步生成文字,而是採用一種 “由粗到細” 的方式。一開始,它會生成一堆看起來像噪音一樣的東西,然後通過幾步 “去噪” 操作,把這些噪音逐漸變成有意義的文字。這就像是你一開始拿到一團亂麻,然後一點點梳理,最後變成了一根根整齊的線。

因為擴散模型不用像自回歸模型那樣一步步來,所以它在推理和組織回答方面更有優勢。它可以同時考慮很多資訊,而不是只盯著前面生成的內容。這就像是你寫文章的時候,可以同時考慮整篇文章的結構,而不是只看前一句話。而且,擴散模型還可以不斷修正自己的錯誤,就像你寫完一篇文章後,可以回頭檢查並修改一樣。

(二)速度優勢

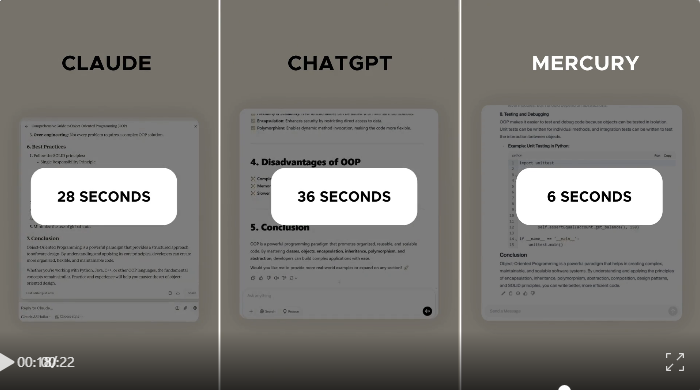

說到速度,Mercury 簡直是快得讓人驚嘆。它比目前那些經過速度最佳化的自回歸語言模型快了 5 - 10 倍。在 NVIDIA H100s 這種硬體上,它的運行速度能超過 1000 個詞 / 秒。這個速度以前只有用定製晶片才能達到,而現在 Mercury 用普通的硬體就能做到。就好比你以前得開一輛超級跑車才能達到 300 公里 / 小時的速度,現在一輛普通的家用轎車就能做到。

Mercury Coder 是 Mercury 系列中的一個專門用於程式碼生成的模型。在標準的編碼基準測試中,它的表現非常出色,經常超過那些經過速度最佳化的自回歸模型,比如 GPT - 4o Mini 和 Claude 3.5 Haiku。而且它的速度比這些模型快了 10 倍不止。相比之下,那些經過速度最佳化的自回歸模型最多也就 200 個詞 / 秒,而一些前沿模型甚至不到 50 個詞 / 秒。這就像是你以前寫程式碼得花一整天時間,現在只需要一個小時就能完成。

(三)應用場景

1. 改進Agent應用 :Mercury 的速度和效率讓它在需要大量規劃和長篇生成的應用中表現得非常出色。比如說,如果你想讓 AI 幫你安排一天的行程,它可以在幾秒鐘內生成一個詳細的計畫,而不是像以前那樣需要幾分鐘甚至更長時間。

2. 高級推理 :Mercury 可以利用錯誤修正來修復幻覺並提升回答質量。這就像是你寫完一篇文章後,可以回頭檢查並修改錯誤,而不是像以前那樣只能一步步來。而且它可以在幾秒鐘內完成推理,而不是像以前的模型那樣需要幾分鐘。

3. 可控生成 :Mercury 可以編輯輸出內容,按任意順序生成詞。比如在你寫文章的時候,可以隨時修改某一段內容,而不是只能從頭到尾寫。使用者可以填補文字,讓輸出符合安全等目標,或者生成符合使用者指定格式的內容。

4. 邊緣應用 :由於 Mercury 的效率非常高,它在資源受限的環境中表現得非常出色。比如說,在手機或者筆記型電腦上執行階段,它不會佔用太多資源,這就像是你用一部普通的手機就能流暢運行大型遊戲一樣。

Mercury Coder 的實際表現

Mercury Coder 在 Copilot Arena 上的表現也非常亮眼。它和 GPT - 4o Mini 並列第二,超過了 Gemini - 1.5 - Flash 和 GPT - 4o 這些模型。而且它還是最快的模型,比 GPT - 4o Mini 快了大約 4 倍。這就像是你參加一場跑步比賽,不僅跑得比別人快,還能拿到第二名的好成績。

大家可以在 Inception Labs 和 Lambda Labs 合作的 playground 上親自體驗 Mercury Coder 的強大能力。你只需要打開網頁,輸入你的程式碼需求,Mercury Coder 就能以非常快的速度生成高品質的程式碼。這就像是你有一個超級聰明的程式碼助手,隨時可以幫你解決問題。

未來展望

Mercury Coder 只是 Inception Labs 推出的一系列 dLLM 中的第一個。目前,用於聊天應用的模型已經在封閉測試中了。擴散語言模型將會為語言模型解鎖一系列新能力,比如更高效的推理、更可控的生成以及在邊緣裝置上的更好表現。未來,我們可能會看到更多基於 Mercury 的應用,比如智能客服、程式碼助手、甚至是個人 AI 助理。

Inception Labs 推出的 Mercury 系列模型給我們帶來了全新的思路和可能性。它不僅在速度上有了巨大的提升,還在推理和生成質量上有了顯著的改進。讓我們一起期待它在更多領域的應用。

現在可以從參考資料處點選進入Mercury Coder,一起體驗這個模型的飛速生成吧!

體驗入口

https://chat.inceptionlabs.ai/

Inception Labs. (n.d.). Introducing Mercury, the first commercial - scale diffusion large language model.

https://www.inceptionlabs.ai/news (CSTC人工智慧)