2024年面世! 谷歌將發佈首款AR眼鏡,攜裸眼3D「魔鏡」佈局元宇宙

進軍元宇宙,谷歌也不甘落後。 近日,谷歌被爆出其秘密研發的AR眼鏡,代號Project Iris,預計2024年面世。

進軍元宇宙,谷歌也不甘落後。

據兩位知情人士透露,谷歌最近開始加緊研發AR眼鏡,內部代號為Project Iris,希望在2024 年上市。

2024推出,代號Iris

預計2024年發佈的這款AR眼鏡將採用谷歌最新處理器,全自研的Tensor晶元,而且還支援在安卓系統上運行。

不過,未來應該會使用一個全新的操作系統。

前段時間谷歌的招聘信息顯示,谷歌正在招聘招聘一支「AR操作系統」團隊,專注於為「創新的AR設備」構建軟體。

與蘋果即將推出的頭顯一樣,谷歌的AR設備使用外向攝像頭將計算圖形與現實世界融合,創造出比Snap和Magic Leap等現有AR眼鏡更身臨其境的混合現實體驗。

由於電量的限制,谷歌會使用其數據中心去遠端渲染一些圖形,並通過互聯網連接將它們傳送到AR眼鏡中。

知情人士表示,在這次眼鏡研發過程中,Pixel團隊也參與了硬體設計的一部分。

但具體未來會以 Pixel 去命名 AR 眼鏡還是未知的,因為 Project Iris 在谷歌內部是一個嚴格保密的專案。

「鴿了」10年的AR眼鏡

Project Iris專案,可以說,是谷歌AR眼鏡研發的一個轉捩點。

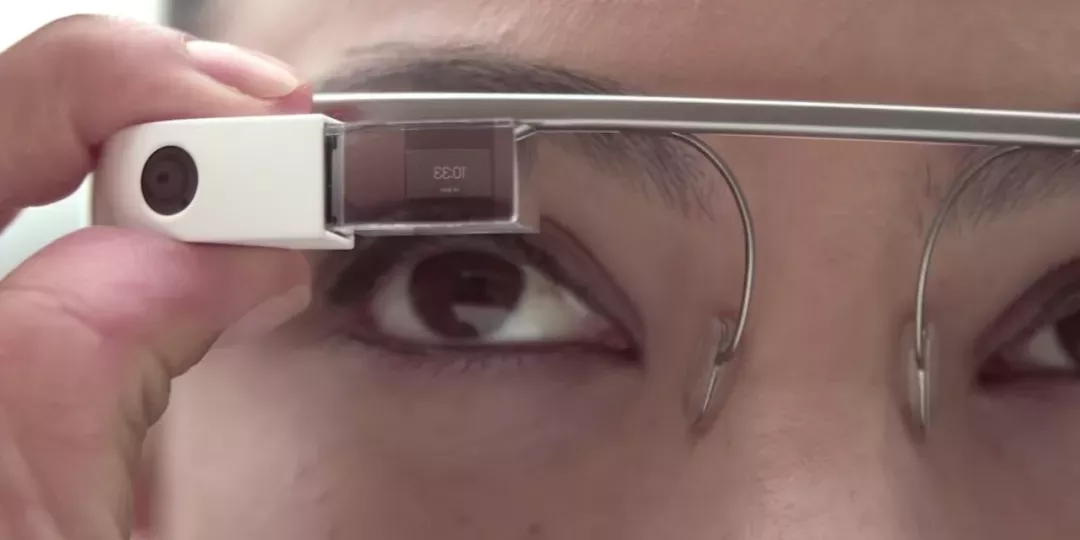

其實早在2012年,谷歌就發佈了AR眼鏡的原型機,類似於一副滑雪護目鏡,而且不需要與外部電源連接。

隨著一波硬體和軟體的升級,2014年成功登陸美國市場,售價1500美元。 然而,在2015年卻因為各種負面新聞被迫下架。

2017年,谷歌決定將AR眼鏡的應用轉向工業。

同年,蘋果發佈了用於為手機構建AR體驗的ARKit,這直接打了谷歌一個措手不及。

這場爭奪戰,以及谷歌隨後擱置的許多虛擬實境專案,讓它的AR和VR團隊成員對其方向的轉變感到士氣低落。

儘管急於追趕,但谷歌在打造新形式的AR硬體方面似乎落後於同行。

此後,谷歌在AR眼鏡的硬體研發上明顯保持沉默,並且選擇專注於研發Google Lens、視覺搜尋引擎和谷歌地圖中的AR方向相關的軟體功能。

除了早期那款AR眼鏡原型,谷歌對AR表現出的興趣還可以追溯到對Magic Leap的早期投資。

2019年的一次採訪中,Clay Bavor表示,「我將我們所處的階段描述為深度研發,專注於在閉門造車的關鍵上」。

緊接著,一年後,谷歌收購了初創公司North,其第一副智能眼鏡為Focals。

但是當前就不同了,因為「元宇宙」是當下不可迴避也不能忽視的話題。

2021年,是元宇宙奇點爆發的元年。 先是3月Robolox上市,開啟了「元宇宙」第一股。 後是10月,紮克伯格直接把Facebook名字都改成了Meta,全力奔向元宇宙。

緊接著,微軟、輝達、蘋果、Unity等科技公司也紛紛在元宇宙領域進行佈局。

現在看來,在去年元宇宙奇點第一年中,谷歌還沒有在元宇宙佈局上正式發聲。

皮查伊密友帶隊研發

據透露,負責未來AR眼鏡的核心研發團隊大約有300人,谷歌計劃再招聘數百人。

其中,這一專案leader是Clay Bavor,工作將向CEO皮查伊彙報。

2021谷歌I/O大會上曾公佈了一個超高解析度視頻聊天室Project Starline專案,它便是由Clay Bavor負責的。

Bavor多年來一直負責谷歌內部與VR和AR相關的工作,他還是皮查伊的密友。

2021年11月,Bavor正式回歸,被任命為谷歌實驗室副總,負責包括Starline專案、Iris和谷歌內部產品孵化器Area 120。

從事Iris專案的其他一些成員包括:

Shahram Izadi:高級工程總監,同時負責谷歌的ARCore軟體工具包

Eddie Chung:產品管理高級總監,曾負責Google Lens產品

Scott Huffman:谷歌智慧助理的副總裁

Mark Lucovsky:谷歌AR操作系統高級總監

Kurt Akeley:工程師,也是光場相機初創公司Lytro的前首席技術官

此外,據報導,谷歌最近還在加拿大招聘與光波導相關的人才。

去年10月,皮查伊在財報電話會議上表示,谷歌正在考慮AR,它將成為我們的主要投資領域。

但目前尚不清楚谷歌是否計劃像 Meta 那樣大舉投資,而Meta已經在這一領域投入百億美元。

「元宇宙」雙彩蛋:Starline

谷歌希望在2024年之前與Iris一起發佈Starline。

這或許是谷歌在元宇宙中佈局的兩顆棋子。

用慣了skype或者zoom等傳統視頻聊天技術的人,第一次使用starline會感到大為震驚。

傳統的視頻通話技術無法克服感官上的距離感。 和你聊天的ta以2D平面的形式展現在你面前。 接收到的聲音也明顯是從使用的設備——手機、平板或是電腦中傳出來。

必須承認這些技術手段給相隔兩地的人們提供了「面對面」交流的機會。 但是,有沒有可能徹底消除這種距離感? 谷歌認真思考了這個問題,並且成功了。

谷歌耗時五年,研發出這麼一款黑科技——Starline3D視頻通話技術。

不得不說,谷歌在這個專案上下了大手筆。 Starline3D視頻通華技術概括來說有兩大特點。 一個是真實,另一個是不需要佩戴任何設備。

一個65吋的光場顯示幕,外加預先佈置的十幾個感測器和攝像頭,就構成了這樣一個聊天室。

這些攝像頭和感測器的作用可不是拍下聊天者的外貌,顯示在對方的顯示幕上。 每一個攝像頭和感測器的作用,是通過不同角度捕捉人像,利用深度學習進行即時壓縮,把這些數據傳輸到對面,在顯示幕上重建成3D影響播放。

這意味著,這是對人像的「重建」。 即時重建人物影像就可以讓彼此的感受變得無與倫比的真實。 好像和自己聊天的人真真切切地坐在自己對面一樣。

採集到的數據的傳輸與普通的視頻會議一樣基於WebRTC,而谷歌獨特的壓縮演算法使得雙向實時傳輸3D影像成為可能。

另一大特點是不需要佩戴任何設備。 傳統的VR頭顯,智慧眼鏡完全不需要。 甚至,根據谷歌發佈的概念圖,上述的攝像頭和感測器都放在一張桌子內部。

稍加裝飾,你甚至會以為這就是你的書桌,而和你聊天的人就坐在書桌對面。

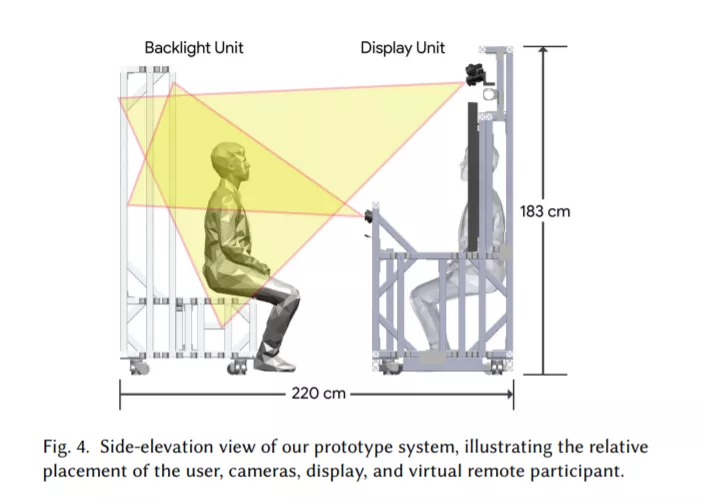

根據谷歌給出的技術圖,這一套設備包括:一個包含顯示器、攝像頭、揚聲器、麥克風、照明器和計算機的顯示單元,和包含紅外背光並用作 bench seat 的背光單元。 兩個單元都包含向牆壁和天花板傾斜的白色 LED 燈條,用於產生柔和的反射照明。

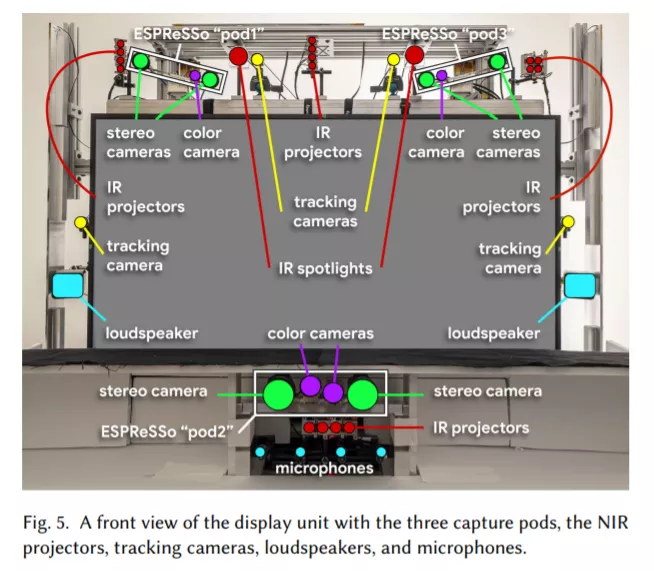

而捕獲子系統由三個同步立體的 RGBD 捕獲 pod 組成:兩個在顯示器上方,一個在顯示器下方的「中牆」(middle wall)中。

更下方的pod包括一個額外的彩色相機,用於放大拍攝物件的臉部。 另外,四個單色追蹤攝像頭中的兩個在顯示器上方,其餘兩個一側一個,用於捕捉眼睛、耳朵和嘴巴的高速廣角圖像。

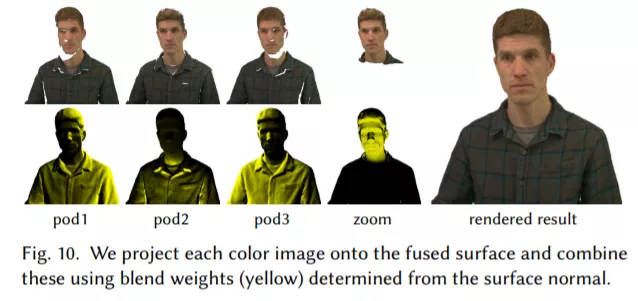

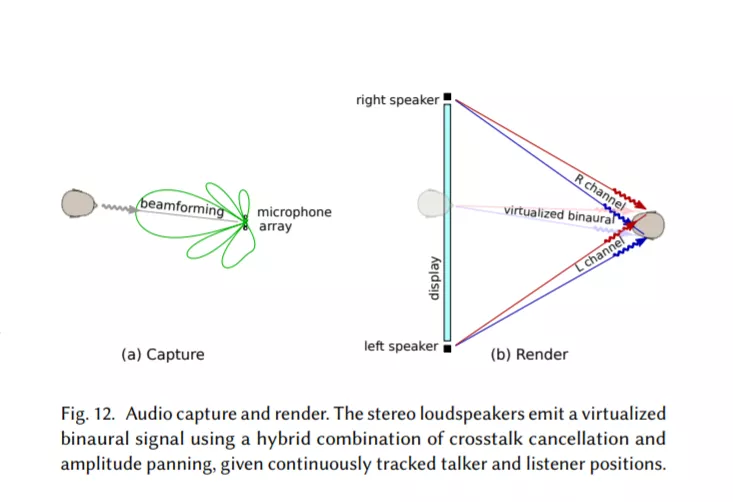

渲染的方式如下圖所示。

而pod就是上述提到的RGBD捕獲裝置。

這樣渲染出的人物影響,更加逼真,栩栩如生。

最後不得不提一下Starline的聲音系統。

這套系統使用了talker-tracked 波束成形、混響消減、WebRTC 傳輸、talker/listener-tracked 虛擬音訊合成、雙耳串擾消除分頻組合以及振幅平移等技術。 目的都是為了讓聲音聽起來就像是和你面對面的人在說話。

值得一提的是,谷歌工程師表示,這套設備在標準辦公網路環境下就可以運行。 看來Starline技術被廣泛推廣應該不是不可能的事。 雖然造價看起來十分昂貴,但是谷歌並未披露有關其價格的更多細節。

想像一下未來的某一天,每家每戶都能擁有一套Starline通話設備,家人親朋都可以隨時隨地面對面交流。 你期待嗎?(mMetaverse)

參考資料:

https://www.theverge.com/2022/1/20/22892152/google-project-iris-ar-headset-2024

https://www.theverge.com/2021/12/2/22813731/google-project-starline-specs-features-research-paper-8k-tv-microphones-camera-capture-pods