OpenAI這波,不是造手機,而是造下一代算力入口。

🧨OpenAI豪擲65億美元,“拿下”Jony Ive!

AI圈、算力圈、硬體圈、設計圈,全都炸了!

OpenAI宣佈計畫以高達65億美元估值收購蘋果前設計總監Jony Ive創立的公司io,目標非常明確:

要一起打造一款“AI原生硬體”——一個屬於AI時代的超級終端。

注意,不是手機,不是耳機,也不是筆記本,而是——

一個全新的“人機互動入口”,一個從0到1重新定義算力使用方式的硬體物種。

🧠Altman的算盤不是硬體,而是“終端算力場景的重構”

從算力視角看,這起併購釋放出三個超級訊號:

1. AI終端的落地,將從“中心雲”轉向“邊緣算力+協同AI”

ChatGPT之前依賴雲端GPU大模型推理;

- 接下來,Altman要讓AI貼身陪伴,就意味著邊緣側AI推理需求爆發;

- 不僅是設計上的革命,更是算力架構上的再分配。

👉 你以為他們聯合一起做產品?其實他們在改寫雲-邊-端的算力路徑。

2. 每一個AI終端背後,都是一個“推理小工廠”

Ive做的是“外殼”,但OpenAI的關鍵在於——

如何把推理部署到裝置上:

是用高通晶片跑LLM?還是自研AI專核?

- 模型是壓縮版GPT-4?還是LoRA微調後的小模型?

- 資料傳輸、快取、同步、安全,怎麼處理?

這些不是消費電子問題,而是AI算力系統終極難題,涉及:

晶片能效比最佳化

- 模型剪枝與蒸餾

- 前端/後端推理分層

- 本地部署與遠端協同的異構計算編排

3. 一旦AI終端爆發,最先爆的是邊緣算力產業鏈

別再盯著GPU資料中心了,AI終端的興起可能帶動:

ARM架構晶片、AI SoC需求激增;

- 模型部署平台如ONNX Runtime、TensorRT加速器重回聚光燈;

- 整套邊緣AI推理工具鏈(編譯器、量化器、最佳化器)迎來黃金周期;

- LLM壓縮訓練平台(如vLLM、MLC.ai)走向台前;

- ……

這會是另一個兆級的算力細分風口,誰先入場誰就可能先吃肉。

🎯OpenAI為何現在出手硬體?兩個字:控制!

ChatGPT已然是超級應用,但Altman知道,如果控制不了硬體入口、晶片生態和推理場景,他終將淪為:

給別人打工的AI作業系統。

就像當年的Android輸給iOS,就是因為沒能把軟硬一體做穿。

這次找Jony Ive,是為了補上OpenAI最短的短板:“AI需要一張臉”。

但這張臉的背後,是:

端側AI算力的新平台;

- 微模型部署的新場景;

- 私域推理的新入口;

- 控制AI使用方式的第一步。

說白了——AI終端是OpenAI對抗蘋果、微軟、Google的“地面戰”。

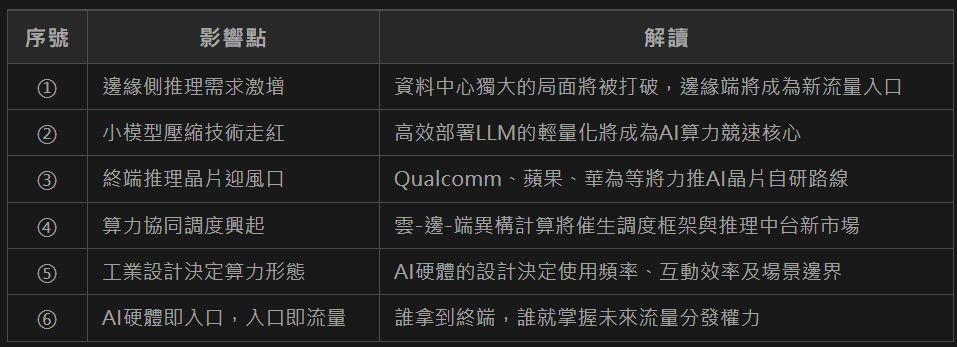

📊對AI算力行業的六大影響(建議收藏)

🔍這是AI算力從“工業設施”走向“消費場景”的分水嶺

OpenAI×Jony Ive,不僅是科技圈的跨界聯名,更是AI算力商業化路徑的加速器。從今天起,“算力 = 模型訓練”的時代正在終結,取而代之的是:

“算力 = 模型部署 × 使用者場景 × 即時推理”的新範式。

這不僅是趨勢,而是下一場產業鏈洗牌的訊號! (AI算力那些事兒)