在上週的《誰是AI晶片的超強輔助? 》一文中,我們以「輝達計畫採購三星HBM」為切入點,系統介紹了記憶體晶片市場、儲存復甦對於整個半導體週期的意義,以及記憶體晶片的新路線、AI算力晶片的好搭檔——HBM 。到今天,HBM的熱度仍在發酵,以儲存技術著稱的韓國晶片股漲勢紅火,推動中韓半導體指數上行。

我們不妨重申HBM的投資邏輯:AIGC模型需要AI伺服器進行訓練和推理→AI伺服器採用中高端GPU是發展趨勢→HBM具有高頻寬、高容量、低延時、低功耗等優勢,可作為GPU內存晶片加快AI數據處理速度;也即,無論是科技大廠間關於AI的“軍備競賽”,還是AI模型對下游千行百業的賦能,AI伺服器需求的爆發或將持續帶動HBM市場規模擴張,打開各儲存廠業績成長預期。

那麼,這個熱鬧該怎麼看呢?

相關性較強的無疑是手握技術與產品的公司。同樣在《誰是AI晶片的超強輔助? 》一文中,我們提到當下的HBM市場基本上也是被三大儲存巨頭(SK海力士、三星、美光)瓜分,2022年三家市佔率分別為50%、40%、10%。

暫時領先的SK海力士佔的是先行者的便宜:2014年與AMD聯合開發全球首款HBM,之後持續研發迭代HBM2(2018)、HBM2E(2020)、HBM3(2021)、HBM3E(2023),併計劃在2026年量產HBM4,可以說,SK海力士一手引領了從HBM1到HBM3E的技術路徑,其發展方向主要以堆疊層數增加、速率/頻寬/IO數量增長為主。以業界最新技術HBM3E(依堆疊層數可進一步細分為8層HBM3E和12層HBM3E)為例,作為輝達先前唯一的HBM3供應商,SK海力士宣布已正式量產8層HBM3E,並在GTC大會上表示將率先向輝達供應。(來源:TrendForce,GTC 2024)

在其身後,三星電子虎視眈眈,其佈局直接從HBM2開始:2016年量產HBM2,2020年推出HBM2E,2021年推出HBM-PIM(存算一體)將內存半導體和AI處理器合二為一,2022年量產HBM3,2024年發布HBM3E。尤其令它的競爭對手感到危機感的是,三星前幾天在GTC大會上公開了它的12層HBM3E實物並獲得了黃仁勳認證,而據報道,輝達最快預計將從9月開始大量購買三星的12層HBM3E,後者或成為輝達12層HBM3E的獨家供應商。須知,SK海力士雖然開始量產8層HBM3E,但因部分工程問題,並未能推出12層HBM3E,而12層HBM3E相對於8層HBM3E的好處正是其增幅超過50%的頻寬和容量。(來源:TrendForce,alphabiz,中金公司)

相較於你追我趕的韓國公司,美國的美光更顯低調。據TrendForce,該公司進軍HBM相對較晚,2020年開始提供HBM2,並直接跳過HBM3佈局HBM3E(2023),並同樣在今年官宣量產8層HBM3E,此外,據美光透露,其8層HBM3E將供給輝達的AI晶片H200 GPU。同樣據公司透露,其HBM3E今年的產能已經全部賣光,明年的大部分產能也已經被預訂。

市場火熱程度可見一斑。握有大手筆擴產計畫的韓國公司則更受青睞。

三星目前已花費105億韓元購買韓國天安廠區內部分建築及設備,計劃在天安廠建立一條新封裝線,用於大規模生產HBM,並預計追加投資7,000億-1兆韓元。在此步調下,公司預計2024年HBM產量將比2023年成長2.5倍,2025年或將再次翻倍。

SK海力士亦預計2024年HBM產能可望同比翻倍成長、到2030年公司HBM出貨量可達到每年1億顆,還計劃在美國印第安納州建造一座先進製造工廠、並與閃存製造商鎧俠在日本共同生產HBM。 SK海力士也更想花錢:計畫在2024年維持10兆韓元的新增資本支出(比2023年增加近七成)以支持HBM產能成長。對這家公司來說,決勝在當下,更在未來——

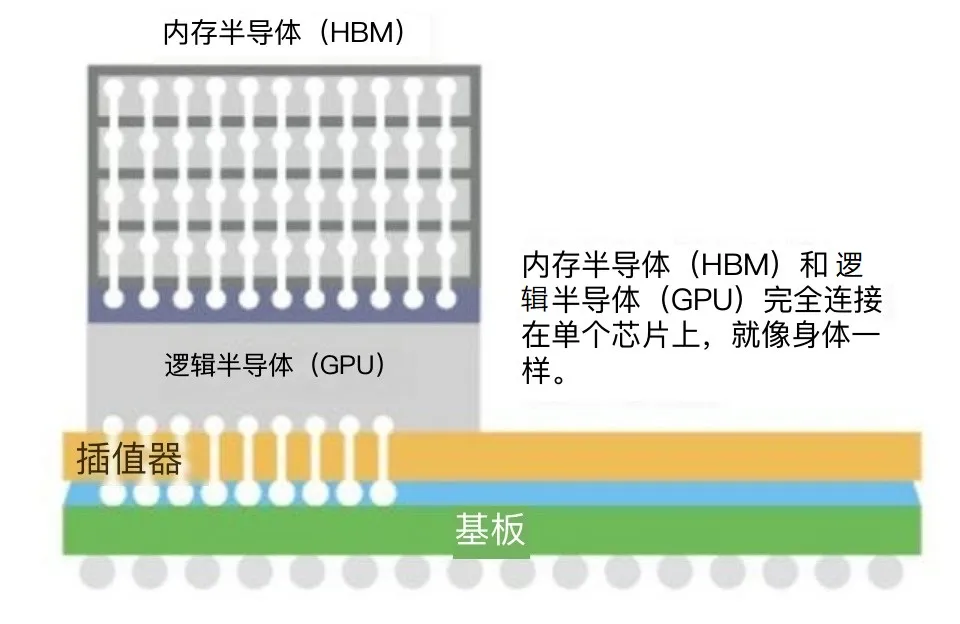

SK海力士計畫在2026年發布並量產的HBM4可能會直接堆疊在邏輯晶片(GPU)上,而非像前幾代一樣放置在GPU一旁的中介層上。其可行性我們今天尚且不做討論,只假設技術成立,那麼過去邏輯晶片與記憶體晶片相互獨立的情況將有可能被顛覆,面對一個邏輯+儲存的融合體,我們所熟悉的半導體生態和產業分工可能會迎來巨震。

這是技術進步的魅力,也是半導體產業正在發生的事情。本輪AI革命為基座產業帶來的煥新,可能遠遠超乎我們想像。

繼續提示關注中韓半導體指數。(華泰柏瑞指數投資)