巨大飛躍!給輝達1.6兆個晶體管,它就能承托全球互聯網流量

輝達(Nvidia)一年一度的GTC大會昨天如期而至,兩年一更新的GPU架構Hopper也正式亮相。

今年,NVIDIA創始人兼CEO黃仁勳在輝達新總部大樓發布了一系列新品,從新架構GPU H100,到Grace CPU 超級晶片,再到汽車、邊緣計算的硬件新品,以及全面的軟件更新。

H100 GPU將在今年第三季度出貨,明年上半年開始供貨Grace CPU超級晶片。

輝達的全新發布再次向外界宣告,輝達不止是一家晶片公司,而是全棧計算公司。他們正在加強其在AI、汽車等領域的領導力,同時也在努力佔領下一波AI浪潮以及元宇宙的先機。

當然,作為一家發明GPU的公司,輝達的全新GPU架構依舊是GTC 2022最值得關注的新品。

Nvidia Hopper新架構以美國計算機領域的先驅科學家Grace Hopper 的名字命名,將取代兩年前推出的NVIDIA Ampere 架構。相比上一代產品,基於Hopper架構的H100 GPU實現了數量級的性能飛躍。

黃仁勳表示,20個H100 GPU 便可承托相當於全球互聯網的流量,使其能夠幫助客戶推出先進的推薦系統以及實時運行數據推理的大型語言模型。

基於H100 GPU構建的各種系統,以及與Grace CPU 超級晶片組合的各種系統,配合輝達多年構建強大的軟件生態,將成為了輝達掀起新一代計算浪潮的能量。

1. 最新Hopper架構H100 GPU的6大突破

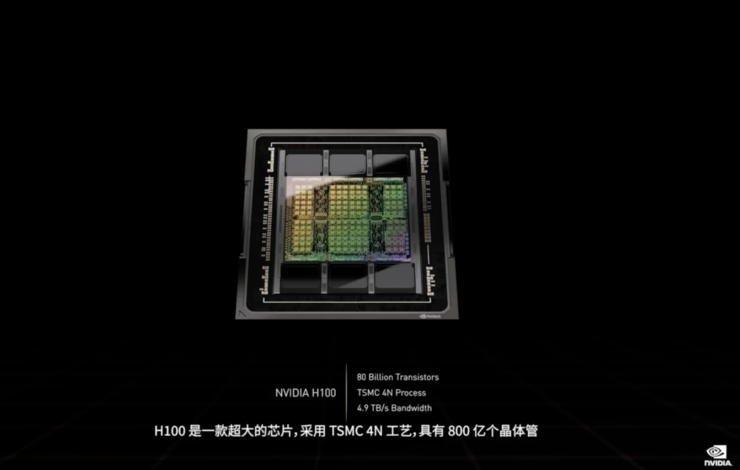

黃仁勳2020年從自家廚房端出的當時全球最大7nm晶片Ampere架構GPU A100,兩年後有了繼任者——Hopper架構H100。輝達H100 GPU採用專為輝達加速計算需求設計優化的TSMC 4N 工藝,集成800億個晶體管,顯著提升了AI、HPC、顯存帶寬、互連和通信的速度,並能夠實現近5TB/s 的外部互聯帶寬。

H100同時也集多個首個於一身,包括首款支持PCIe 5.0 的GPU,首款採用HBM3 的GPU,可實現3TB/s 的顯存帶寬,全球首款具有機密計算功能的GPU。

H100的第二項突破就是其加速器的Transformer 引擎能在不影響精度的情況下,將Transformer網絡的速度提升至上一代的六倍。Transformer 讓自監督學習成為可能,如今已成為自然語言處理的標準模型方案,也是深度學習模型領域最重要的模型之一。

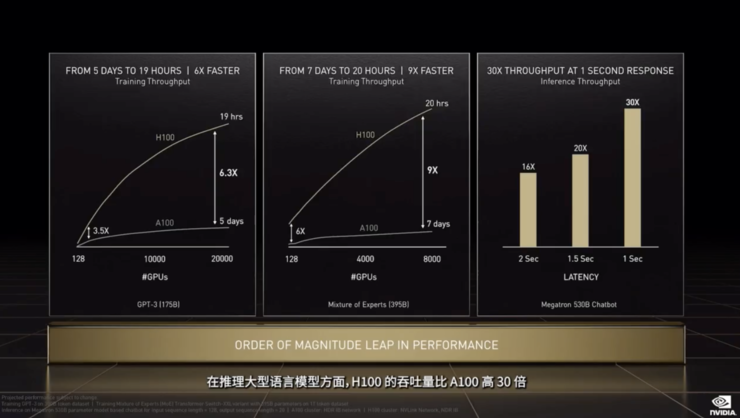

雷峰網(公眾號:雷峰網)了解到,H100 將支持聊天機器人使用功能超強大的monolithic Transformer 語言模型Megatron 530B,吞吐量比上一代產品高出30 倍,同時滿足實時對話式AI 所需的次秒級延遲。

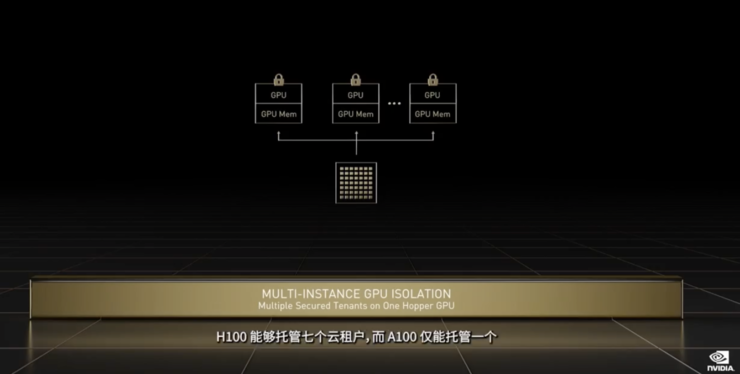

H100的第三項突破是進一步升級的第二代多實例GPU。上一代產品中,輝達的多實例GPU技術可將每個A100 GPU分割為七個獨立實例來執行推理任務。新一代的Hopper H100與上一代產品相比,在雲環境中通過為每個GPU 實例提供安全的多租戶配置,將MIG 的部分能力擴展了7 倍。

MIG 技術支持將單個GPU 分為七個更小且完全獨立的實例,以處理不同類型的任務。

H100的第四項突破就是其是全球首款具有機密計算功能的加速器,隱私計算此前只能在CPU上實現,H100是第一個實現隱私計算的GPU,可保護AI 模型和正在處理的客戶數據。機密計算的優勢在於其不僅能確保數據的機密性,同時還不影響性能,可以應用於醫療健康和金融服務等隱私敏感型行業的聯邦學習,也可以應用於共享雲基礎設施。

H100的第五項突破是在互聯性能的提升,支持第4代NVIDIA NVLink。如今的AI模型越來越大,帶寬成為了限制超大規模AI模型迭代的阻礙。輝達將NVLink 結合全新的外接NVLink Switch,可將NVLink 擴展為服務器間的互聯網絡,最多可以連接多達256 個H100 GPU,相較於上一代採用NVIDIA HDR Quantum InfiniBand網絡,帶寬高出9倍。

這項突破可以帶來的直接提升是,利用H100 GPU,研究人員和開發者能夠訓練龐大的模型,比如包含3950億個參數的混合專家模型,訓練速度加速高達9倍,訓練時間從幾週縮短到幾天。

H100的第六個突破是對新的DPX 指令可加速動態規劃,適用於包括路徑優化和基因組學在內的一系列算法,輝達的測試數據顯示,與CPU 和上一代GPU 相比,其速度提升分別可達40 倍和7 倍。

另外,Floyd-Warshall 算法與Smith-Waterman 算法也在H100 DPX指令的加速之列,前者可以在動態倉庫環境中為自主機器人車隊尋找最優線路,後者可用於DNA和蛋白質分類與折疊的序列比對。

硬件突破之外,輝達也發布了一系列相應的軟件更新,包括用於語音、推薦系統和超大規模推理等工作負載的NVIDIA AI 軟件套件,還有60多個針對CUDA-X的一系列庫、工具和技術的更新,能夠加速量子計算和6G 研究、網絡安全、基因組學和藥物研發等領域的研究進展。

顯而易見,H100 GPU的六項突破,帶來的是更高的計算性能,但這些性能的提升和優化,全都指向AI計算,這也是輝達進一步擴大在AI計算領域領導力的體現。

2. NVIDIA Eos,比全球最快超級

計算機AI性能快4 倍

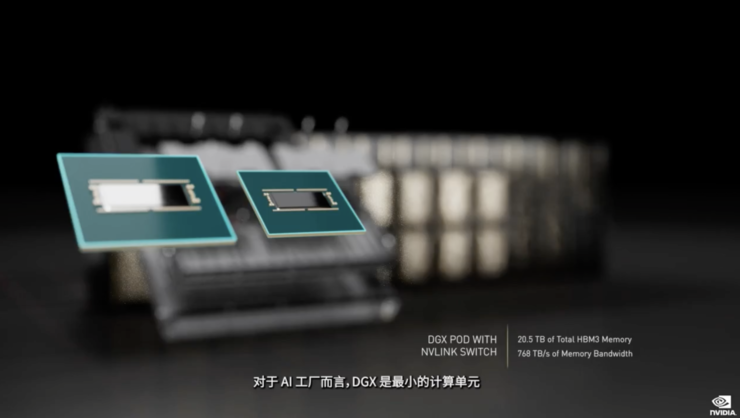

有了性能升級的GPU,輝達的第四代DGX系統DGX H100也隨之亮相,包括DGX POD和DGX SupePOD兩種架構,能夠滿足大型語言模型、推薦系統、醫療健康研究和氣候科學的大規模計算需求。

每個DGX H100 系統配備八塊NVIDIA H100 GPU,並由NVIDIA NVLink連接,能夠在新的FP8 精度下達到32 Petaflop 的AI 性能,比上一代系統性能高6倍。每個DGX H100 系統還包含兩個NVIDIA BlueField-3 DPU,用於卸載、加速和隔離高級網絡、存儲及安全服務。

新的DGX SuperPOD 架構採用全新的NVIDIA NVLink Switch 系統,通過這一系統最多可連接32個節點,總計256塊H100 GPU。第四代NVLink與NVSwitch相結合,能夠在每個DGX H100系統中的各個GPU之間實現900 GB/s 的連接速度,是上一代系統的1.5 倍。

新一代DGX SuperPOD性能同樣顯著提升,能夠提供1 Exaflops的FP8 AI性能,比上一代產品性能高6倍,能夠運行具有數万億參數的龐大LLM工作負載,有助於推動氣候科學、數字生物學和AI 未來的發展。

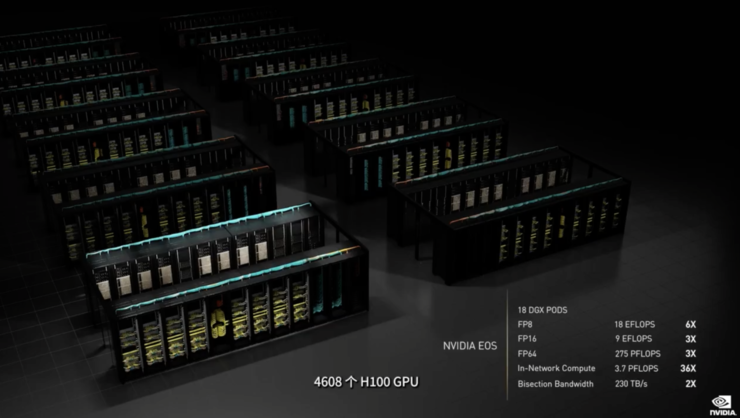

基於DGX H100,輝達將在今年晚些時候開始運行全球運行速度最快的AI 超級計算機—— NVIDIA Eos,“Eos"超級計算機共配備576 台DGX H100 系統,共計4608 塊DGX H100 GPU,預計將提供18.4 Exaflops 的AI 計算性能,比日本的Fugaku(富嶽)超級計算機快4 倍,後者是目前運行速度最快的系統。

在傳統的科學計算方面,Eos 超級計算機預計將提供275 Petaflop 的性能。

黃仁勳說:“對於NVIDIA 及OEM 和雲計算合作夥伴,Eos 將成為先進AI 基礎設施的藍圖。”

576個DGX H100系統能夠構建一台全球運行速度最快的AI系統,少量的DGX SuperPOD 單元組合,也可以為汽車、醫療健康、製造、通信、零售等行業提供開發大型模型所需的AI 性能。

黃仁勳提到,為支持正在進行AI開發的DGX客戶,NVIDIA DGX-Ready軟件合作夥伴(包括Domino Data Lab、Run:ai和Weights & Biases等)提供的MLOps解決方案將加入"NVIDIA AI 加速"計劃。

為了簡化AI部署,輝達還推出了DGX-Ready 託管服務計劃,能夠為希望與服務提供商開展合作來監督其基礎設施的客戶提供支持。通過新的DGX-Ready 生命週期管理計劃,客戶還可以藉助新的NVIDIA DGX 平台升級其現有DGX 系統。

3. Grace CPU 超級晶片,最強大的CPU

去年的GTC 21,輝達首款數據中心CPU Grace亮相,輝達的晶片路線也升級為GPU+DPU+CPU。

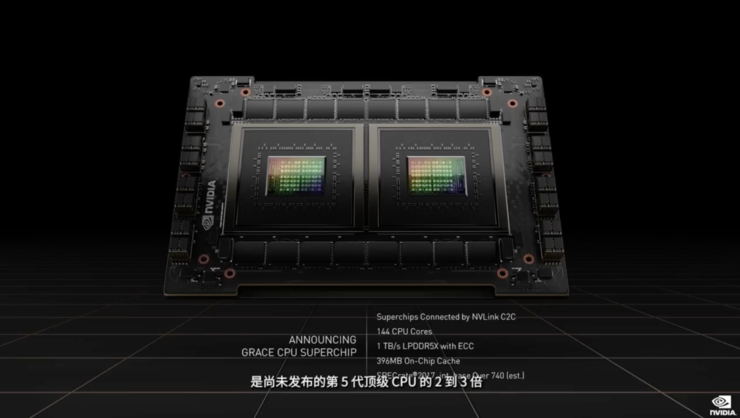

今年的GTC 22,輝達由推出了首款面向AI 基礎設施和高性能計算的基於Arm Neoverse的數據中心專屬CPU Grace CPU 超級晶片。

Grace CPU 超級晶片是專為AI、HPC、雲計算和超大規模應用而設計,能夠在單個插座(socket)中容納144 個Arm 核心,在SPECrate 2017_int_base 基準測試中的模擬性能達到業界領先的740 分。根據NVIDIA 實驗室使用同類編譯器估算,這一結果較當前DGX A100搭載的雙CPU(AMD EPYC 7742)相比高1.5 倍以上。

黃仁勳稱讚:“Garce的一切都令人驚嘆,我們預計Grace超級晶片屆時將是最強大的CPU,是尚未發布的第5代頂級CPU的2到3倍。”

據介紹,依托帶有糾錯碼的LPDDR5x 內存組成的創新的內存子系統,Grace CPU 超級晶片可實現速度和功耗的最佳平衡。LPDDR5x 內存子系統提供兩倍於傳統DDR5設計的帶寬,可達到1 TB/s ,同時功耗也大幅降低,CPU加內存整體功耗僅500瓦。

值得注意的是,Grace CPU超級晶片由兩個CPU晶片組成,通過NVLink-C2C互連在一起。NVLink-C2C 是一種新型的高速、低延遲、晶片到晶片的互連技術,將支持定制裸片與NVIDIA GPU、CPU、DPU、NIC 和SOC 之間實現一致的互連。

借助先進的封裝技術,NVIDIA NVLink-C2C 互連鏈路的能效最多可比NVIDIA晶片上的PCIe Gen 5高出25倍,面積效率高出90倍,可實現每秒900GB乃至更高的一致互聯帶寬。

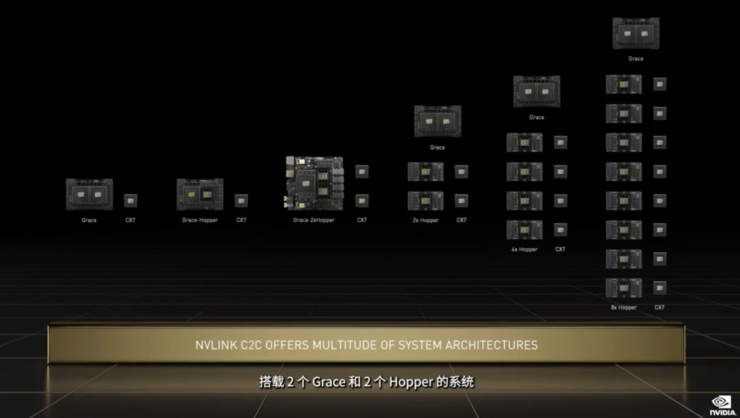

得益於Grace CPU 超級晶片可以運行所有的輝達計算軟件棧,包括NVIDIA RTX、NVIDIA HPC、NVIDIA AI 和Omniverse。Grace CPU超級晶片結合NVIDIA ConnectX-7 網卡,能夠靈活地配置到服務器中,可以作為獨立的純CPU系統,或作為GPU加速服務器,搭載一塊、兩塊、四塊或八塊基於Hopper的GPU,客戶通過維護一套軟件棧就能針對自身特定的工作負載做好性能優化。

這次發布的NVIDIA Grace超級晶片系列以及去年發布的Grace Hopper超級晶片均採用了NVIDIA NVLink-C2C 技術來連接處理器晶片。

輝達表示,除NVLink-C2C外,NVIDIA還將支持本月早些時候發布的UCIe(Universal Chiplet Interconnect Express,通用小晶片互連傳輸通道)標準。與NVIDIA晶片的定制晶片集成既可以使用UCIe 標準,也可以使用NVLink-C2C。(雷鋒網)